题目内容

(请给出正确答案)

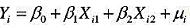

题目内容

(请给出正确答案)

在多元线性回归模型中,误差项ε也可以被各个自变量进行线性表示()

答案

答案

请输入或粘贴题目内容

搜题

请输入或粘贴题目内容

搜题

拍照、语音搜题,请扫码下载APP

拍照、语音搜题,请扫码下载APP

题目内容

(请给出正确答案)

题目内容

(请给出正确答案)

答案

答案

更多“在多元线性回归模型中,误差项ε也可以被各个自变量进行线性表示()”相关的问题

更多“在多元线性回归模型中,误差项ε也可以被各个自变量进行线性表示()”相关的问题

第1题

A.向前选择法是从模型中没有自变量开始,然后将所有自变量依次增加到模型中

B.向后剔除法是先对所有自变量拟合线性回归模型,然后依次将所有自变量剔除模型

C.逐步回归法是将向前选择法和向后剔除法结合起来,但不能保证得到的回归模型一定就显著

D.逐步回归法选择变量时,在前面步骤中增加的自变量在后面的步骤中有可能被剔除,而在前面步骤中剔除的自变量在后面的步骤中也可能重新进入到模型中

第3题

多元线性判别模型(MDA)是一种统计学的技术,被用于计量信用风险,下列选项中属于该模型的主要优点的是()。

A.可以对样本进行清晰的分类

B.可以同时分析不同的变量

C.可以确定一系列的判定系数

D.以上答案都正确

第4题

A.二元线性回归

B.二元二次线性回归

C.多元线性回归

D.一元线性回归

第6题

(1)如果真实的模型是Yi=β1Xi+μi,但你却拟合了一个带截距项的模型Yi=α0+α1Xi+νi,试评述这一设定误差的后果。

(2)在(1)中,假设真实的模型是带截距项的模型,而你却对过原点的模型进行了普通最小二乘回归。请评述这一模型误设的后果。

第8题

A.无限期分布滞后模型不可以转换为一阶自回归模型

B.科伊克模型和自适应预期模型都存在解释变量与随机干扰项同期相关问题

C.局部调整模型中解释变量与随机干扰项没有同期相关,因此可以应用OLS估计

D.自适应预期模型最初表现形式是Yt=β0+β1Xte+μt

E.估计自回归模型时的主要问题在于滞后被解释变量的存在可能导致它与随机干扰项相关,以及随机干扰项出现序列相关

第9题

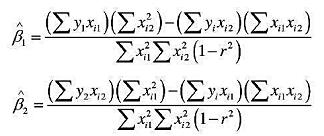

试证明:二元线性回归模型 中变量X1与X2的参数OLS估计可以写成:

中变量X1与X2的参数OLS估计可以写成:

其中,r为X1与X2的相关系数。讨论r等于或接近1时,该模型的估计问题。

第10题

A、修正的R^2﹤R^2

B、修正的R^2>=R^2

C、修正的R^2只能大于零

D、修正的R^2可能为负值